开源ollama-batch-processor,Ollama 模型批处理文本文件,支持翻译、有声读物格式和智能文本释义

一、介绍

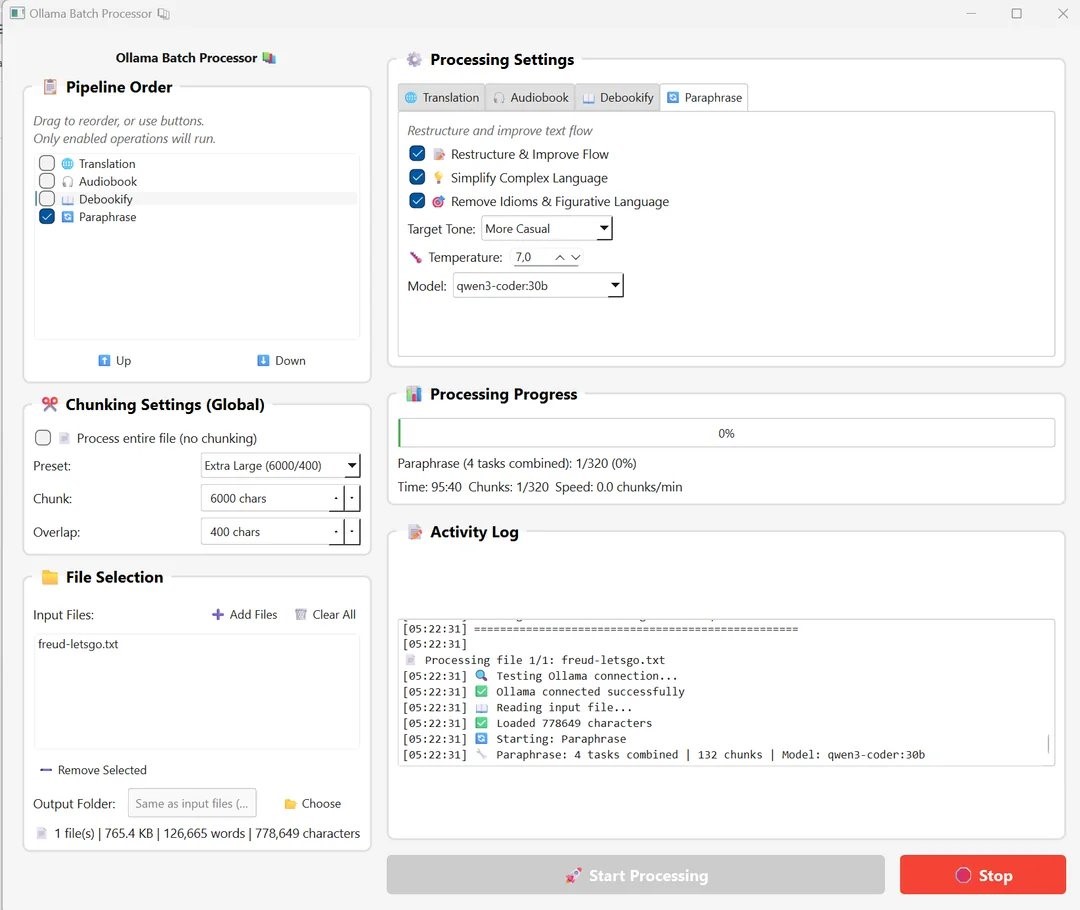

一个功能强大的基于 PySide6 的 GUI 应用程序,用于使用 Ollama LLM 模型批处理文本文件。支持翻译、有声读物格式和智能文本释义,并具有可自定义的管道作。

Github:https://github.com/hclivess/ollama-batch-processor

二、特征

- 翻译:语言之间的专业翻译,上下文保留

- 有声读物格式:优化文本转语音系统的文本

- 释义:改善流程、简化语言、删除成语、调整语气

- 流水线处理:按自定义顺序链接多个作

- 智能分块:具有重叠和边界检测功能的智能文本分割

- 渐进式保存:每个管道步骤都保存到单独的文件中

- 批处理:按顺序处理多个文件

- 模型选择:每次作使用不同的 Ollama 模型

三、硬件要求

- Python 3.8+

- 已安装并运行 Ollama

- 至少安装了一种 Ollama 型号

三、快速入门

启动 Ollama:在终端运行ollama serve

启动应用程序:运行python main.py

添加文件:点击“📁添加文件”并选择.txt文件

配置管道:

- 检查要启用的作(翻译、有声读物、释义)

- 拖动作以重新排序

- 配置每个作的设置

选择模型:为每个作选择 Ollama 模型

设置分块:选择预设或启用“处理整个文件”

开始处理:点击“开始” 🚀

监控进度:观看活动日志和进度条

访问输出:在输出目录中查找处理过的文件和步骤文件

版权声明:本站所有文章版权均归AiNeuOS所有,任何个人、媒体、网站、团体等注明来源后均可以转载。但是不得在非我站的服务器上建立镜像,否则,我站将依法保留追究相关法律责任的权利。

关注公众号: